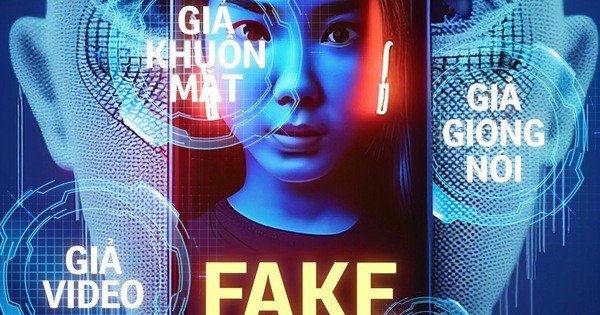

Cùng với sự phát triển của công nghệ ứng dụng trí tuệ nhân tạo AI, giờ đây tội phạm lừa đảo chiếm đoạt tài sản ngày càng có những chiêu thức tinh vi hơn, đó là giả mạo gương mặt, giọng nói. Các đối tượng đã tạo ra những sản phẩm công nghệ có âm thanh, hình ảnh giả người ngoài đời thực với độ chính xác cao để lừa đảo, yêu cầu “nạn nhân” chuyển tiền. Dù đã nhiều lần cảnh báo nhưng hiện nay vẫn có nhiều nạn nhân “mắc bẫy”…

Nhiều người sập bẫy

Mới đây, CAP Đức Giang, quận Long Biên (Hà Nội) phối hợp cùng nhân viên giao dịch Ngân hàng TMCP Đầu tư và Phát triển Việt Nam Thành Đô (BIDV Thành Đô), đã chặn thành công phi vụ lừa đảo của đối tượng giả danh Công an, gọi điện uy hiếp đôi vợ chồng già, bắt chuyển khoản hơn 3 tỷ đồng để “chứng minh vô tội”.

Cặp vợ chồng may mắn đó là ông T và bà P, trú ở phường Đức Giang. Kể lại sự việc với PV ANTĐ, Thiếu tá Trần Hải Long, Phó Trưởng CAP Đức Giang cho biết, trực ban CAP nhận được phản ánh từ phòng giao dịch của BIDV Thành Đô, về việc đang có 2 khách hàng cao tuổi làm thủ tục mở tài khoản để chuyển số tiền hơn 3 tỷ đồng. Nhân viên ngân hàng đã khéo léo hỏi mục đích mở tài khoản và chuyển tiền, nhưng 2 vị khách nhất định không nói. Thậm chí, vị khách nữ còn lo lắng: “Có nói các cô cũng không giúp minh oan được cho chúng tôi”!

Lập tức, chỉ huy CAP Đức Giang phân công 1 đồng chí CSKV và 1 trinh sát hình sự đến phòng giao dịch. Lúc này, hai vị khách cao tuổi sắp hoàn tất thủ tục mở tài khoản, còn điện thoại của ông T thì liên tục bị 1 đối tượng nam giới gọi, giục đẩy nhanh thủ tục chuyển tiền. “Anh ở đâu gọi đấy, tôi là Công an phường Đức Giang đây…”, vừa nghe trinh sát hình sự nói qua điện thoại, đối tượng lập tức tắt máy.

Chứng kiến màn đối thoại giữa Công an thật và Công an giả, vợ chồng ông bà T như bừng tỉnh và thuật lại nguyên nhân đến phòng giao dịch ngân hàng.

Vợ chồng ông bà T cùng cán bộ CAP Đức Giang tại phòng giao dịch Ngân hàng BIDV

Trước đó khi đang ở nhà, họ bị một nhóm 3 đối tượng tự xưng là cán bộ CAQ..., thay nhau gọi điện báo người vợ có một tài khoản ngân hàng đang bị nợ hơn 60 triệu đồng và thông báo ông bà cùng người nhà có liên quan đến đường dây mua bán ma tuý. Các đối tượng gọi điện uy hiếp, bắt họ chuyển khoản hơn 3 tỷ đồng… để “chứng minh mình vô tội”, và không được để cho người khác biết. Tinh vi hơn, các đối tượng còn dùng phần mềm “Deepfake” (phần mềm giả hình ảnh và giọng nói bằng công nghệ ứng dụng trí tuệ nhân tạo), rồi gọi video qua zalo, đặt tên hiển thị zalo là số điện thoại đường dây nóng của CATP... để khiến “con mồi” thêm tin tưởng. Không một chút nghi ngờ, đôi vợ chồng này đến ngân hàng làm thủ tục rút 2 sổ tiết kiệm 3 tỷ 98 triệu đồng thì may mắn được nhân viên ngân hàng cùng các cán bộ chiến sỹ CAP Đức Giang kịp thời ngăn chặn.

Không may mắn như đôi vợ chồng ông bà T, anh Q cũng nhận cuộc gọi video qua zalo hiện hình ảnh và giọng nói của một người bạn của anh, hỏi vay tiền. Không ngần ngại, anh Q đã chuyển 20 triệu cho đối tượng này. Anh Q chia sẻ, đối tượng gọi video call. Nếu để ý kỹ sẽ thấy chỉ mỗi miệng trên gương mặt cử động, nhưng anh cho là do đường truyền kém, gọi được vài giây thì ngắt. Bởi cũng đang vội nên khi được tin nhắn số tài khoản thì anh đã chuyển khoản. Đến khi anh Q nhận ra mình bị lừa thì đã muộn.

Nhận diện chiêu trò lừa đảo

Rõ ràng, chiêu thức này tuy không mới nhưng đã trở nên tinh vi hơn khi kẻ gian đồng thời thực hiện cuộc gọi video mạo danh, phát video giả nhằm xác thực thông tin cho tài khoản giả, tăng độ tin cậy để thực hiện trót lọt hành vi lừa đảo. Các video này có thể khiến người xem tin rằng họ đang nhìn thấy và nghe thấy người thật đang nói chuyện. Và trên thực tế đã có không ít người đã trở thành nạn nhân của thủ đoạn lừa đảo này.

Theo các chuyên gia, những năm gần đây, công nghệ sinh trắc học, đặc biệt là dấu vân tay, khuôn mặt đã phát triển mạnh mẽ trong nhiều lĩnh vực và giúp tăng cường bảo mật cho người dùng. Tuy nhiên, sự phổ biến của các công nghệ này cũng mang đến những rắc rối và cả thiệt hại khi các đối tượng lừa đảo sử dụng gương mặt, giọng nói và chiếm đoạt tiền trong tài khoản bằng cách lợi dụng kẽ hở trong việc sử dụng công nghệ này.

Các đối tượng dùng phần mềm “Deepfake” giả hình ảnh và giọng nói giống đến chân thực

Theo Thiếu tá Trần Hải Long, Phó Trưởng CAP Đức Giang, nếu thận trọng người dùng vẫn hoàn toàn có thể nhận biết được qua các dấu hiệu như: Chuyển động của nhân vật và gương mặt sẽ không được mượt mà; giọng nói cũng không tự nhiên. “Để bảo vệ tiền trong tài khoản của mình, bên cạnh việc thận trọng trước những cuộc gọi, trao đổi liên quan đến tiền, đến tài chính, cũng khuyến cáo người dùng nên tránh để lộ lọt các thông tin cá nhân, hình ảnh, dữ liệu sinh trắc học để tránh bị kẻ xấu lợi dụng khai thác”, Thiếu tá Trần Hải Long chia sẻ.

Cũng theo các chuyên gia an ninh mạng, để nhận diện cuộc gọi lừa đảo “Deepfake”, một số dấu hiệu nhận biết như: thời gian gọi thường rất ngắn, chỉ vài giây. Bên cạnh đó, khuôn mặt của người gọi thường thiếu tính cảm xúc và khá "trơ" khi nói hoặc tư thế của họ trông lúng túng, không tự nhiên, hướng đầu và cơ thể của họ trong video không nhất quán với nhau. Ngoài ra, có thể thấy màu da của nhân vật trong video bất thường, ánh sáng kỳ lạ và bóng đổ không đúng vị trí. Điều này có thể khiến video trông rất giả tạo và không tự nhiên; âm thanh sẽ không đồng nhất với hình ảnh, có nhiều tiếng ồn bị lạc vào “clip” hoặc “clip” không có âm thanh…